- Harmonogramy AGI: pionierzy AI przewidują, że AI na poziomie człowieka jest możliwa w ciągu kilku dekad. CEO DeepMind, Demis Hassabis, szacuje, że „w ciągu najbliższych pięciu do dziesięciu lat, być może bliżej pięciu,” możemy mieć AI posiadającą „wszystkie zdolności poznawcze, jakie mają ludzie” theguardian.com. Sam Altman z OpenAI nawet deklaruje: „Jesteśmy teraz pewni, że wiemy, jak zbudować AGI… W 2025 roku możemy zobaczyć pierwszych agentów AI ‘dołączających do siły roboczej’” blog.samaltman.com. Dla porównania, ankiety wśród badaczy AI zazwyczaj dają bardziej konserwatywne prognozy mediany (np. ~2040–2070 dla 50% szans na AGI research.aimultiple.com). Eksperci ostrzegają, że gdy AGI się pojawi, „superinteligencja” (AI znacznie przewyższająca możliwości człowieka) może pojawić się szybko po niej research.aimultiple.com, theguardian.com.

- Wpływ ekonomiczny: Sztuczna inteligencja zrestrukturyzuje rynki pracy. Na przykład McKinsey szacuje, że do 2030 roku w zaawansowanych gospodarkach można zautomatyzować nawet 30% godzin pracy (szczególnie w przypadku rutynowych prac biurowych, fabrycznych i usługowych) mckinsey.com. Analitycy Goldman Sachs i Citigroup podobnie przewidują, że około 50–60% istniejących miejsc pracy będzie wymagało znacznego dostosowania do AI lub automatyzacji do połowy wieku mckinsey.com, entrepreneur.com. CEO Vista Equity, Robert Smith, otwarcie przewidział, że AI sprawi, iż „wszystkie stanowiska pracy” zajmowane przez pracowników wiedzy ulegną zmianie lub znikną – zażartował na konferencji finansowej w 2025 roku, że „40% [profesjonalistów] będzie miało agenta AI, a pozostałe 60% będzie szukać pracy” entrepreneur.com. Tradycyjne branże (produkcja, transport, obsługa klienta) mogą stracić wiele miejsc pracy, nawet jeśli wzrośnie zapotrzebowanie na specjalistów AI oraz pracowników w sektorze zdrowia, edukacji i nauk ścisłych mckinsey.com, entrepreneur.com.

- Wszechobecność narzędzi AI: Sztuczna inteligencja już przekształca sektory od opieki zdrowotnej po finanse. W medycynie, na przykład, Światowe Forum Ekonomiczne zauważa, że diagnostyka oparta na AI może „wykrywać wczesne oznaki chorób” i nawet przewidywać choroby przewlekłe na lata przed pojawieniem się objawów weforum.org. W badaniach klinicznych AI dorównywała lub przewyższała lekarzy w wykrywaniu uszkodzeń po udarze i złamań weforum.org. W edukacji spersonalizowane algorytmy nauczania i boty do nauki języków obiecują dostosowanie lekcji do każdego ucznia, choć eksperci ostrzegają przed zagrożeniami dla prywatności danych i uprzedzeniami. W obronności rozwijane są tysiące autonomicznych dronów i inteligentnej broni. Firmy finansowe wykorzystują AI do wykrywania oszustw, algorytmów handlowych i botów obsługi klienta – jeden z raportów wykazał, że 54% miejsc pracy w finansach ma wysokie prawdopodobieństwo automatyzacji przez AI entrepreneur.com. Żadna dziedzina nie pozostanie nietknięta.

- Kwestie etyczne i bezpieczeństwa: Czołowi naukowcy podkreślają ryzyka obok korzyści. UNESCO ostrzega, że bez odpowiednich zabezpieczeń AI „grozi powielaniem rzeczywistych uprzedzeń i dyskryminacji, pogłębianiem podziałów i zagrażaniem podstawowym prawom i wolnościom człowieka” unesco.org. Pionierzy tacy jak Yoshua Bengio ostrzegają, że „igraszka z losem ludzkości” grozi nam, jeśli będziemy działać bez kontroli 3quarksdaily.com. Ostatni konsensus 25 czołowych badaczy AI z Oksfordu (w tym Hinton, Yao, Russell, Kahneman, Song i inni) ostrzegł, że AI wkrótce może opanować hakowanie, propagandę, a nawet wojnę biologiczną. Twierdzą, że niekontrolowany postęp „może zakończyć się masową utratą życia i … wyginięciem ludzkości” ox.ac.uk. Toczą się gorące debaty etyczne dotyczące uprzedzeń algorytmicznych, prywatności i uzbrojonej AI. Światowe Forum Ekonomiczne i inne organizacje aktywnie opracowują ramy zarządzania, aby zapobiegać szkodom.

- Geopolityka i regulacje: Wyścig w dziedzinie AI ma charakter globalny. UE uchwaliła przełomową Ustawę o AI regulującą systemy wysokiego ryzyka; USA preferują wytyczne i dobrowolne kontrole; Chiny kładą nacisk na stabilność nadzoru reuters.com. Ponad 60 państw (w tym USA) podpisało niewiążący wojskowy „plan działania” dotyczący AI w 2024 roku, ale Chiny wstrzymały poparcie reuters.com. Eksperci ONZ proponują obecnie globalny panel nadzoru nad AI oraz standardy zapewniające przejrzystość i równość reuters.com. Napięcia rosną, gdy rządy rywalizują o przywództwo w AI: eksperci ostrzegają, że „wyścig zbrojeń AI” między supermocarstwami może prowadzić do lekkomyślnych wdrożeń aicerts.ai, washingtonpost.com.

- Społeczeństwo i środowisko: Rozwój AI może pogłębić nierówności: miliarder z branży funduszy hedgingowych Ray Dalio ostrzega, że będzie „ograniczona liczba zwycięzców i cała masa przegranych… najbardziej skorzysta górny 1 do 10%,” jeśli nie zostaną wprowadzone polityki takie jak powszechny dochód podstawowy lub przekwalifikowanie businessinsider.com. UNESCO podkreśla, że AI już teraz pogłębia istniejące nierówności wśród grup marginalizowanych unesco.org. W kwestii środowiska AI to miecz obosieczny. Może przyspieszyć rozwiązania klimatyczne (np. sieci energetyczne, badania nad fuzją), ale trenowanie ogromnych modeli pochłania ogromne ilości energii. Badanie MFW wykazuje, że centra danych związane z AI mogą zwiększyć globalną emisję dwutlenku węgla o ok. 1,2% i emisję w USA o ok. 5,5% do 2030 roku przy obecnych politykach imf.org. To podkreśla potrzebę zielonej energii i efektywności wraz ze skalowaniem AI.

Sztuczna inteligencja ogólna (AGI) i superinteligencja

„Sztuczna inteligencja ogólna” (AGI) odnosi się do SI, która dorównuje lub przewyższa ludzką inteligencję we wszystkich dziedzinach. Niektórzy liderzy technologiczni mówią dziś o AGI jako czymś nieuchronnym. Demis Hassabis z DeepMind powiedział The Guardian, że AGI może pojawić się „w ciągu najbliższych pięciu do dziesięciu lat, być może bliżej tej dolnej granicy”, co zapoczątkuje erę „radykalnej obfitości”, w której SI rozwiąże największe problemy theguardian.com. Sam Altman z OpenAI podziela tę pilność. W styczniu 2025 roku na swoim blogu stwierdził, „Jesteśmy teraz pewni, że wiemy, jak zbudować AGI w tradycyjnym rozumieniu… wierzymy, że w 2025 roku możemy zobaczyć pierwszych agentów SI ‘dołączających do siły roboczej’”blog.samaltman.com. Wyobraża sobie, że te superinteligentne narzędzia „znacząco przyspieszą odkrycia naukowe i innowacje”, uwalniając dobrobyt blog.samaltman.com.Jednak badania wśród ekspertów SI pokazują szeroki zakres prognoz: niektóre akademickie ankiety umieszczają medianę pojawienia się AGI w połowie wieku research.aimultiple.com. Dokładny harmonogram jest gorąco dyskutowany. Co ważne, wielu obawia się, że po osiągnięciu AGI superinteligencja – SI znacznie przewyższająca ludzkie zdolności poznawcze – może pojawić się bardzo szybko. W ankiecie ekspertów z 2007 roku zauważono, że „większość ekspertów uważa, iż przejście do superinteligencji nastąpi stosunkowo szybko, w przedziale od zaledwie 2 do około 30 lat” po AGI research.aimultiple.com. Noblista, fizyk Nick Bostrom od dawna ostrzega, że niekontrolowana superinteligencja może stanowić egzystencjalne zagrożenie, jeśli nie zostanie starannie dostosowana do ludzkich wartości. W 2024 roku 25 czołowych naukowców SI potwierdziło to: w swoim wspólnym artykule ostrzegli, że nieokiełznany rozwój SI „może zakończyć się masową utratą życia i… wyginięciem ludzkości”ox.ac.uk.

Nawet ci, którzy są optymistami, nawołują do ostrożności. Bengio, pionier uczenia głębokiego, krytykował lekkomyślne postawy: odpowiadając szefom firm technologicznych, którzy twierdzą, że AGI jest nieuniknione, odparł „chcą… zagrać w kości z przyszłością ludzkości. Osobiście uważam, że to powinno być kryminalizowane.”3quarksdaily.com. Krótko mówiąc, AGI jest w umysłach wielu ekspertów zarówno jako ostateczny przełom, jak i głębokie ryzyko. Proponowane są działania przygotowawcze w zakresie zarządzania i badań nad bezpieczeństwem – od zespołów ds. dostosowania w OpenAI po nowe międzynarodowe organy regulacyjne AI – aby skierować AGI ku korzyściom i uniknąć katastrofy ox.ac.ukunesco.org.Automatyzacja, miejsca pracy i gospodarka

Automatyzacja napędzana przez AI jest gotowa, by przekształcić pracę i gospodarki na całym świecie. Badania przewidują, że wiele miejsc pracy o średnich dochodach zniknie lub ulegnie transformacji. Na przykład Światowe Forum Ekonomiczne poinformowało, że 4,5 miliarda ludzi nie ma podstawowej opieki zdrowotnej – AI mogłaby pomóc zaspokoić takie potrzeby – ale automatyzacja również „przyspiesza już i tak rosnące nierówności ekonomiczne”, ostrzegał Stephen Hawking weforum.org. Hawking i inni eksperci ostrzegali, że robotyka i AI „zniszczą miejsca pracy klasy średniej” (pozostawiając ludziom jedynie role opiekuńcze, kreatywne lub nadzorcze) weforum.org.

Najnowsze analizy potwierdzają to zakłócenie: McKinsey prognozuje, że do 2030 roku około 30% obecnych godzin pracy może zostać zautomatyzowanych dzięki AI i oprogramowaniu, szczególnie w administracji biurowej, produkcji i obsłudze klienta mckinsey.com. Goldman Sachs i Citi również szacują, że do 2040–2050 roku nawet 50–60% miejsc pracy będzie wymagało znacznego przekształcenia lub automatyzacji villagevoicenews.com, entrepreneur.com. Wysoko postawieni menedżerowie powtarzają ten szok: Robert Smith z Vista Equity przewidział, że „wszystkie miejsca pracy” zajmowane przez miliard pracowników umysłowych ulegną zmianie pod wpływem AI, tworząc „hiperproduktywnych” liderów i pozostawiając wielu innych bez pracy entrepreneur.com. Ostrzegł, że wkrótce duża część specjalistów z branży finansowej zostanie zastąpiona przez agentów AI entrepreneur.com.Ekonomiści podkreślają, że nie jest to wyłącznie katastrofalne – pojawią się nowe miejsca pracy i branże – ale przejście to jest poważne. Raport McKinsey podkreśla, że konieczne będzie masowe przekwalifikowanie pracowników, aby uniknąć polaryzacji rynku pracy mckinsey.com. Już teraz menedżerowie, tacy jak Larry Fink z BlackRock, zauważają, że AI jest „już widoczna w sektorach takich jak finanse i prawo”, a Jamie Dimon z JPMorgan przewiduje, że AI zautomatyzuje wiele zadań biurowych w ciągu dekady villagevoicenews.com, entrepreneur.com.

W miarę jak automatyzacja zwiększa produktywność, prawdopodobnie podniesie PKB – jedna z analiz MFW łączy wzrost wydajności pracy napędzany przez AI z około +1% rocznego wzrostu imf.org. Jednak korzyści nie będą rozłożone równomiernie. Ray Dalio z Bridgewater ostrzega przed „ograniczoną liczbą zwycięzców i wieloma przegranymi”: AI może skoncentrować bogactwo wśród górnych 1–10%, jeśli nie zostaną wprowadzone polityki redystrybucyjne (takie jak powszechny dochód podstawowy lub rozszerzone świadczenia socjalne) businessinsider.com. Podsumowując, ekonomiczny wpływ AI to nic innego jak druga rewolucja przemysłowa: radykalnie produktywna dla społeczeństwa, ale także wysoce destrukcyjna, z masową rotacją miejsc pracy, rosnącymi nierównościami i potrzebą nowych systemów zabezpieczenia społecznego weforum.org, businessinsider.com.

Kwestie etyczne i bezpieczeństwo AI

Rewolucja AI rodzi głębokie pytania etyczne i dotyczące bezpieczeństwa. Jednym z głównych problemów jest stronniczość i sprawiedliwość: ponieważ AI uczy się na podstawie danych ludzkich, może przejmować uprzedzenia. UNESCO ostrzega, że AI „grozi powielaniem uprzedzeń i dyskryminacji ze świata rzeczywistego”, jeśli nie będzie etycznie zarządzana unesco.org. Ma to konkretne skutki: systemy rozpoznawania twarzy często mylą się w przypadku osób o ciemniejszej karnacji, algorytmy kredytowe mogą wykluczać mniejszości, a AI w mediach społecznościowych potrafią wzmacniać treści ekstremistyczne. Eksperci domagają się więc przejrzystości i odpowiedzialności.

Problem zgodności jest również kluczowy: jak zapewnić, że potężna AI robi to, czego chcą ludzie? Uczeni tacy jak Stuart Russell twierdzą, że musimy budować AI „udowodnialnie korzystną”. Ostatni konsensusowy artykuł z Oksfordu podkreślił, że obecnie tylko ok. 1–3% badań nad AI dotyczy bezpieczeństwa ox.ac.uk, i wezwał do pilnych działań międzynarodowych. Wzywają rządy do finansowania nadzoru nad AI, egzekwowania testów bezpieczeństwa, a nawet licencjonowania zaawansowanego rozwoju AI ox.ac.uk. Bez takich środków eksperci ostrzegają przed scenariuszami, w których zaawansowana AI ignoruje ludzkie instrukcje lub realizuje szkodliwe cele.

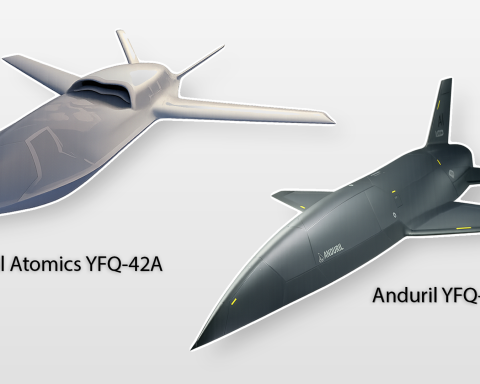

Autonomiczne bronie to kolejny punkt zapalny w kwestiach etycznych. Wojsko rozwija drony i roboty, które mogą wybierać cele bez udziału człowieka. Obrońcy praw człowieka od dawna domagają się zakazu „robotów zabójców”. Dziennikarz Washington Post, Gerrit De Vynck, donosi, że takie systemy są już używane w konfliktach (np. Libia, Górski Karabach) washingtonpost.com. Peter Asaro z Międzynarodowego Komitetu Kontroli Broni Robotycznej ostrzega, że czołowe armie „będą rozpowszechniać” te technologie, ponieważ przesuwają granice możliwości washingtonpost.com. To zapowiada przyszłość, w której wojna będzie w dużej mierze prowadzona przez AI, co rodzi pytania o odpowiedzialność i eskalację konfliktów.

Prywatność to kolejna kwestia: w miarę jak AI przetwarza ogromne ilości danych osobowych, pojawiają się obawy przed wszechobecną inwigilacją. Firmy i rządy mogą wykorzystywać AI do analizy twarzy, telefonów czy aktywności online na niespotykaną dotąd skalę. Eksperci ds. wolności obywatelskich apelują o ścisłe ograniczenia i zgodę użytkowników, by chronić podstawowe prawa.

Krótko mówiąc, wielu liderów opinii podkreśla ostrożność. Pionier deep learningu, Yoshua Bengio, mówi wprost, że ignorowanie ryzyk związanych z AI jest skrajnie nieodpowiedzialne 3quarksdaily.com. Laureat Nagrody Nobla Daniel Kahneman, ojciec chrzestny AI Geoffrey Hinton i inni opowiadają się za działaniami wyprzedzającymi, takimi jak testowanie, a nawet wstrzymanie rozwoju ultrapotężnych systemów. Wszystkie te głosy podkreślają, że etyka i bezpieczeństwo AI powinny być integralną częścią badań i wdrażania, a nie dodatkiem.

AI w kluczowych sektorach

Opieka zdrowotna: Narzędzia AI szybko wspomagają medycynę. Badania kliniczne pokazują, że AI może wykrywać choroby wcześniej lub dokładniej niż ludzie: na przykład jeden z modeli zidentyfikował wczesne sygnały choroby Alzheimera i chorób nerek na lata przed pojawieniem się objawów weforum.org. Raport Światowego Forum Ekonomicznego zauważa, że rozwiązania oparte na AI „mają potencjał zwiększenia efektywności, obniżenia kosztów i poprawy wyników zdrowotnych na całym świecie”weforum.org. Laboratoria radiologiczne i patomorfologiczne wykorzystują AI do wykrywania guzów lub złamań z mniejszą liczbą pomyłek; roboty chirurgiczne sterowane przez AI mogą działać z nadludzką precyzją. Te innowacje obiecują ogromne korzyści, zwłaszcza w regionach o ograniczonym dostępie do opieki. Jednak eksperci, tacy jak dr Caroline Green (Oxford), ostrzegają, że „osoby korzystające z tych narzędzi muszą być odpowiednio przeszkolone… aby ograniczyć ryzyko… takie jak możliwość przekazania błędnych informacji”weforum.org. W praktyce regulatorzy próbują nadążyć: FDA i UE stworzyły ścieżki zatwierdzania diagnostyki AI. Trwają debaty etyczne dotyczące prywatności pacjentów, stronniczości algorytmów w medycynie oraz odpowiedzialności w przypadku błędu AI.

Edukacja: Choć mniej rozwinięta niż opieka zdrowotna, AI już personalizuje nauczanie. Inteligentne aplikacje do nauki dostosowują się do tempa każdego ucznia, a automatyczne ocenianie uwalnia nauczycieli do pracy twórczej. Zwolennicy twierdzą, że AI może pomóc zniwelować luki edukacyjne, zapewniając wysoką jakość nauczania w odległych rejonach. Jednak krytycy apelują o ostrożność: UNESCO podkreśla, że „spersonalizowana” edukacja oparta na AI musi być prowadzona zgodnie z dobrą pedagogiką, a nie wyłącznie wynikami testów unesco.org. Pojawiają się obawy dotyczące nadmiernego polegania na ekranach, cyfrowego wykluczenia (nierówny dostęp do narzędzi AI) oraz ochrony danych uczniów. Wielu ekspertów uważa, że rola nauczycieli będzie się zmieniać, ale nie zniknie: AI może przejąć rutynowe nauczanie, podczas gdy ludzcy pedagodzy skupią się na mentoringu, krytycznym myśleniu i umiejętnościach społecznych.

Obrona i bezpieczeństwo: Sztuczna inteligencja rewolucjonizuje prowadzenie wojen i działania policyjne. Wojska na całym świecie inwestują ogromne środki w AI do rozpoznania, cyberobrony i autonomicznej broni. Algorytmy AI potrafią analizować zdjęcia satelitarne lub przechwytywać komunikację szybciej niż analitycy-ludzie. Amerykański Departament Obrony przyjął zasady dotyczące AI i finansuje projekty takie jak myśliwce autonomiczne w locie. Jednocześnie krytycy ostrzegają, że to ryzykowne. Na przykład Pentagon twierdzi, że ludzie pozostaną „w pętli decyzyjnej”, ale drony bojowe już samodzielnie krążą i atakują cele washingtonpost.com. Eksperci, tacy jak Stuart Russell, przewidują, że bez ścisłego nadzoru systemy AI mogą samodzielnie uruchomić cyber- lub broń biologiczną. Na arenie międzynarodowej istnieje niewiele formalnych traktatów; podczas Szczytu ONZ ds. AI w 2023 roku tylko 60 państw poparło dobrowolne wytyczne dotyczące wojskowej AI, a Chiny wstrzymały się od głosu reuters.com. W cyberwojnie poważnym problemem są także kampanie dezinformacyjne napędzane przez AI i boty hakerskie. Ogólnie rzecz biorąc, AI obiecuje większe możliwości obronne, ale także ryzyko destabilizujących wyścigów zbrojeń i wypadków, jeśli nie zostaną wprowadzone globalne zasady.

Finanse: Wall Street i sektor bankowy są już pełne AI. Fundusze inwestycyjne „quant” wykorzystują uczenie maszynowe do wykrywania trendów rynkowych, a boty do handlu wysokich częstotliwości realizują transakcje w mikrosekundach. Działy zgodności wdrażają AI do wykrywania oszustw i prania pieniędzy. Według Citigroup, 54% miejsc pracy w finansach jest „wysoce automatyzowalnych” przez AI entrepreneur.com. Liderzy biznesu przyznają, że czeka nas przewrót: jak powiedział Smith z Vista, „AI sprawi, że ‘wszystkie’ prace oparte na wiedzy się zmienią… Nie mówię, że wszystkie znikną, ale wszystkie się zmienią” entrepreneur.com. Bloomberg Intelligence prognozuje, że nawet 200 000 miejsc pracy na Wall Street może zniknąć w ciągu pięciu lat. Przewrót jest już widoczny: AI „dramatycznie zmniejsza zatrudnianie na poziomie podstawowym” w technologiach i finansach. Z drugiej strony, finanse także korzystają: McKinsey zauważa, że AI może dodać do 2 bilionów dolarów zysków bankowych do 2028 roku (dzięki cięciu kosztów i nowym usługom). Regulatorzy gorączkowo aktualizują przepisy dotyczące handlu algorytmicznego i danych konsumenckich. Krótko mówiąc, finanse będą w dużej mierze zautomatyzowane, a ludzie będą musieli zdobyć nowe umiejętności, by pracować z „agentami” AI.

Inne sektory (energia, rolnictwo, transport, rozrywka itd.) również przejdą podobne transformacje. Samojezdne pojazdy, wspomagane przez AI projektowanie leków, inteligentne sieci energetyczne, spersonalizowany marketing – lista rośnie z każdym dniem. Ostateczny rezultat będzie się różnić w zależności od branży, ale trend jest jasny: AI staje się podstawową warstwą technologiczną w niemal każdej dziedzinie.

Implikacje geopolityczne i regulacje

Wzrost znaczenia AI wywołał globalną walkę o władzę. Rządy zdają sobie sprawę, że przewaga w dziedzinie AI zapewnia korzyści gospodarcze i militarne. USA, Chiny i Unia Europejska inwestują ogromne środki w badania i rozwój AI aicerts.ai. Chiny, na przykład, mają ambitne plany rozwoju AI i surowe regulacje zapewniające kontrolę rządu; Europa przyjęła ostrożne podejście wraz z wprowadzeniem w 2021 roku AI Act (pierwszego kompleksowego prawa dotyczącego AI), podczas gdy USA głównie wydają niewiążące wytyczne i debatują nad ustawodawstwem. Analiza Reutersa zauważa: „Tylko garstka krajów stworzyła przepisy… UE była na prowadzeniu… uchwalając kompleksowy AI Act, w porównaniu z podejściem Stanów Zjednoczonych polegającym na dobrowolnym przestrzeganiu, podczas gdy Chiny dążyły do utrzymania stabilności społecznej i kontroli państwa.”reuters.com

W wymiarze militarnym napięcia rosną. Grupa około 60 państw pod przewodnictwem USA poparła we wrześniu 2024 roku niewiążące ramy dotyczące broni AI, ale Chiny odmówiły udziału, co zwiększyło obawy przed wyścigiem zbrojeń AI reuters.com. Tymczasem technologiczne supermocarstwa ścigają się w pozyskiwaniu talentów, budowie mocy obliczeniowej superkomputerów i ustalaniu standardów. Kraje w Europie, Azji i Afryce obawiają się pozostania w tyle; eksperci Carnegie Endowment ostrzegają, że „kluczowe decyzje dotyczące celu i zabezpieczeń AI są scentralizowane na Globalnej Północy, mimo że ich skutki odczuwalne są na całym świecie” carnegieendowment.org. To doprowadziło do apeli o bardziej inkluzywne zarządzanie: Zgromadzenie Ogólne ONZ w 2025 roku przyjęło rezolucję (wspieraną przez ponad 100 krajów) dotyczącą równego dostępu do AI.

Międzynarodowe instytucje zaczynają działać. W 2024 roku panel doradczy ONZ zaproponował utworzenie globalnego organu nadzorującego AI, który miałby dzielić się wiedzą naukową i ustalać standardy reuters.com. OECD i G7 wydały zasady dotyczące AI, a organizacje takie jak UNESCO, Bank Światowy i inne podkreślają znaczenie współpracy ponad granicami. Jednak egzekwowanie tych zasad pozostaje rozproszone. Eksperci podkreślają, że brak silnych, egzekwowalnych globalnych norm oznacza, że kraje mogą wykorzystywać AI do nadzoru lub cyberwojny bez ograniczeń. Przedstawiciele społeczeństwa obywatelskiego argumentują, że musimy uniknąć scenariusza „zwycięzca bierze wszystko”; jak donosi Reuters, ONZ ostrzegła, że przy koncentracji AI w rękach kilku korporacji istnieje „niebezpieczeństwo, że technologia może być narzucona ludziom bez ich udziału w decyzji, jak jest wykorzystywana” reuters.com. Krótko mówiąc, AI stała się kwestią strategii międzynarodowej, a światowi przywódcy są pod presją, by opracować mądre polityki lub ryzykować chaosem.

Wpływ na środowisko i społeczeństwo

Społeczne skutki AI są ogromne. Pozytywnie rzecz ujmując, AI może zwiększyć dostęp do usług i tworzyć dobrobyt: od narzędzi edukacyjnych na żądanie po zarządzane przez AI inteligentne miasta optymalizujące zużycie energii. Technologiczni optymiści (jak niektórzy liderzy z Doliny Krzemowej) marzą o „radykalnej obfitości”, w której potrzeby materialne są zaspokojone, a ludzie skupiają się na kreatywności i wypoczynku. Jednak rzeczywistość jest bardziej złożona.

Jednym z kluczowych problemów jest nierówność. Już teraz firmy i kraje biegłe technologicznie wysuwają się na prowadzenie, podczas gdy biedniejsi pracownicy i państwa ryzykują marginalizację. Ostrzeżenie Dalio o „grupie przegranych” podkreśla obawę wielu naukowców: bez interwencji AI może pogłębić przepaść między tymi, którzy mają dostęp do technologii, a tymi, którzy go nie mają businessinsider.com. UNESCO i UNICEF podkreślają, że dziewczęta, mniejszości i regiony rozwijające się często jako pierwsze doświadczają negatywnych skutków AI (stronnicze algorytmy, utrata pracy, brak infrastruktury cyfrowej) unesco.org, carnegieendowment.org. Zapewnienie, by AI przynosiła korzyści wszystkim, będzie wymagało celowych polityk: reformy edukacji, podnoszenia kompetencji cyfrowych i programów społecznych. Altman, Hinton i inni przedstawiciele branży AI publicznie poparli eksperymenty z gwarantowanym dochodem lub przekwalifikowaniem, by pomóc osobom tracącym pracę, przyznając, że „dawanie ludziom pieniędzy… może… dać ludziom lepsze perspektywy” businessinsider.com (choć nie jest to panaceum).

Ślad środowiskowy AI jest również pod lupą. Trenowanie dużych modeli AI wymaga ogromnych centrów danych. Dokument roboczy MFW wskazuje, że przy obecnych trendach AI może znacząco zwiększyć zapotrzebowanie na energię: globalne zużycie energii przez centra danych AI może podnieść emisje o około 1,2% do 2030 roku imf.org, a w niektórych krajach nawet o 5–10%. Jak zauważa jeden z autorów, kluczowe jest dostosowanie polityki energetycznej i technologicznej. Pozytywną stroną jest to, że sama AI może pomóc w walce ze zmianami klimatu — poprzez optymalizację sieci energetycznych, przyspieszenie odkryć materiałowych (np. dla baterii lub paneli słonecznych) oraz ulepszanie modelowania klimatu. W rzeczywistości Hassabis z DeepMind twierdzi, że AI może „zdecydowanie przewyższyć” własne zużycie energii, przyspieszając rozwiązania takie jak synteza jądrowa theguardian.com. Przyznaje jednak również trudne pytanie: gdy AI zwiększa wydajność, scenariusze „nigdy więcej nie musieć pracować” mogą pozbawić ludzi wpływu, jeśli bogactwo nie będzie mądrze dzielone theguardian.com.

Ostatecznie AI przekształci codzienne życie i struktury społeczne. Zobaczymy bardziej spersonalizowane media (na dobre i na złe), inteligentniejsze usługi publiczne, a może nawet towarzyszy AI. Filozof etyki Yuval Noah Harari i inni sugerują, że ludzie będą musieli na nowo odkryć sens i cel, gdy maszyny przejmą rutynowe prace. Wielu przewiduje zmianę kulturową: większy nacisk na sztukę, filozofię i ludzkie relacje, gdy AI odmieni codzienne obowiązki. Ostrzegają jednak: społeczeństwa muszą inwestować w edukację, etykę i debatę obywatelską, aby ludzie nie zostali pozostawieni sami sobie przez falę AI theguardian.comox.ac.uk.

Podsumowując, przyszłość AI to nie lada wyzwanie: obiecuje zdumiewające postępy – lekarstwa na choroby, uwolnienie siły roboczej i przełomy naukowe – ale stawia też głębokie wyzwania. Eksperci – od laureatów Nobla po liderów politycznych – podkreślają, że to, jak pokierujemy rozwojem AI, zdecyduje, czy ta technologia stanie się największym triumfem ludzkości, czy jej najtrudniejszą próbą ox.ac.uk, unesco.org.

Źródła: Autorytatywne analizy i raporty informacyjne z czasopism naukowych, badaczy AI, instytucji globalnych i głównych mediów blog.samaltman.com, theguardian.com, 3quarksdaily.com, weforum.org, businessinsider.com, mckinsey.comweforum.org, washingtonpost.com, entrepreneur.com, reuters.com, imf.org, unesco.org, ox.ac.uk. Obejmują one Światowe Forum Ekonomiczne, Uniwersytet Oksfordzki, UNESCO, McKinsey, MFW, Reuters oraz wypowiedzi czołowych postaci AI.